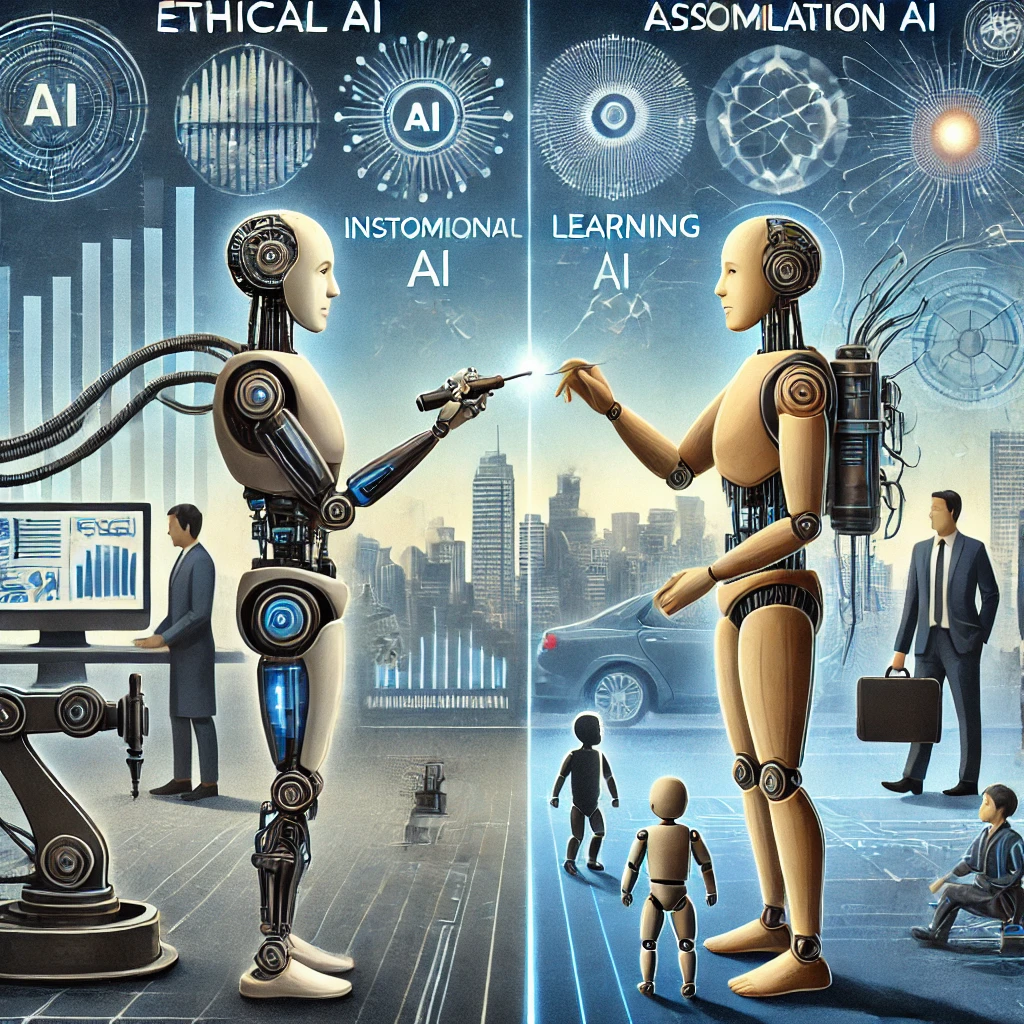

Etica e Agenti di Intelligenza Artificiale: Strumenti e Agenti di Assimilazione

Con il crescente impatto dell’intelligenza artificiale (IA) nella società, una delle questioni più dibattute riguarda l’etica nel design e nell’utilizzo degli agenti di IA. Non tutti gli agenti di IA sono uguali, e comprendere la distinzione tra agenti come strumenti e agenti di assimilazione è cruciale per valutare le implicazioni etiche delle loro applicazioni.

Agenti di IA Strumentali: Mezzi per un Fine

Gli agenti di IA strumentali sono progettati per eseguire compiti specifici, fungendo da strumenti per gli esseri umani. Questi agenti operano su obiettivi definiti, come:

- Automazione di Processi: Algoritmi per migliorare l’efficienza industriale o aziendale.

- Assistenza Tecnologica: Assistenti vocali come Alexa o Siri che rispondono a comandi specifici.

- Decisione Basata sui Dati: Sistemi per l’analisi finanziaria o sanitaria che offrono raccomandazioni basate su modelli predittivi.

Caratteristiche Principali

- Mancanza di Autonomia: Questi agenti non prendono decisioni indipendenti oltre i parametri prestabiliti.

- Responsabilità Umana: Le decisioni finali dipendono sempre da un operatore umano.

- Etica Limitata: L’aspetto etico riguarda principalmente l’uso corretto dei dati e il rispetto della privacy.

Gli agenti strumentali sono meno controversi in termini di etica perché sono percepiti come estensioni delle capacità umane. Tuttavia, errori nei dati o malintenzioni nell’uso possono portare a discriminazioni, bias o decisioni errate.

Agenti di Assimilazione: Interazione e Apprendimento

Gli agenti di assimilazione sono sistemi di IA progettati per interagire e apprendere in modo continuo dal loro ambiente, evolvendo comportamenti che li rendono più “autonomi” nel prendere decisioni. Esempi includono:

- Chatbot Conversazionali Avanzati: Sistemi come ChatGPT che simulano dialoghi complessi.

- Sistemi di Raccomandazione: Algoritmi che apprendono preferenze individuali, come Netflix o Spotify.

- Veicoli Autonomi: Auto che prendono decisioni basate su input ambientali in tempo reale.

Caratteristiche Principali

- Adattamento Dinamico: Questi agenti apprendono dai dati in tempo reale e possono modificare i loro comportamenti.

- Parziale Autonomia: Sebbene limitata da regole, la loro capacità di agire senza intervento umano è più sviluppata.

- Complessità Etica: Le questioni etiche riguardano l’impatto sulle decisioni umane, il rischio di bias algoritmici, e la trasparenza dei processi decisionali.

Questi agenti pongono sfide uniche. Un chatbot che apprende dai dati degli utenti, ad esempio, potrebbe amplificare bias impliciti, mentre un veicolo autonomo deve affrontare dilemmi etici come decidere chi proteggere in caso di incidente inevitabile.

Etica: Una Questione di Controllo e Autonomia

La distinzione tra strumenti e agenti di assimilazione si basa sul grado di autonomia e apprendimento:

- Strumenti: Hanno un ruolo passivo e dipendono interamente dalle intenzioni umane. L’etica si concentra sull’utilizzo responsabile.

- Assimilazione: Possono influenzare l’ambiente o le persone con cui interagiscono, sollevando questioni etiche legate alla trasparenza, all’affidabilità e all’impatto sociale.

Le Sfide per il Futuro

- Trasparenza: Gli agenti, soprattutto quelli di assimilazione, devono essere progettati per rendere comprensibili i loro processi decisionali.

- Responsabilità: È necessario definire chiaramente chi è responsabile quando un agente autonomo causa danni o errori.

- Bias Algoritmico: La lotta contro i pregiudizi nei dati è fondamentale per garantire equità.

- Impatto Sociale: Agenti autonomi possono trasformare il lavoro, l’educazione e le relazioni umane, richiedendo una regolamentazione adeguata.

Conclusione

La distinzione tra agenti strumentali e agenti di assimilazione offre una base per affrontare le sfide etiche legate all’intelligenza artificiale. Mentre gli strumenti sono principalmente una questione di utilizzo responsabile, gli agenti di assimilazione richiedono un’attenzione più profonda, poiché la loro autonomia e capacità di apprendimento li rendono influenti nel modellare le decisioni umane e sociali.

Una governance etica efficace sarà fondamentale per garantire che l’IA, in tutte le sue forme, serva gli interessi della società senza compromettere i valori fondamentali dell’umanità.